Durante 2025 trabajé con estudios de arquitectura e interiorismo incorporando inteligencia artificial dentro de sus flujos reales de proyecto. En ese contexto apareció una conclusión clara: la mayoría de los problemas con la IA no tienen que ver con la tecnología, sino con la falta de criterio para usarla.

En paralelo, también voy viendo los videos y tutoriales de IA, enfocados sólo en el uso para a obtener resultados rápidos, impacto visual inmediato o simplemente likes. Cuestiono ese enfoque: cuando la IA se presenta como atajo, como truco o como «no te quedes afuera», se vacía de sentido dentro de una disciplina que trabaja con ideas, procesos y responsabilidad proyectual.

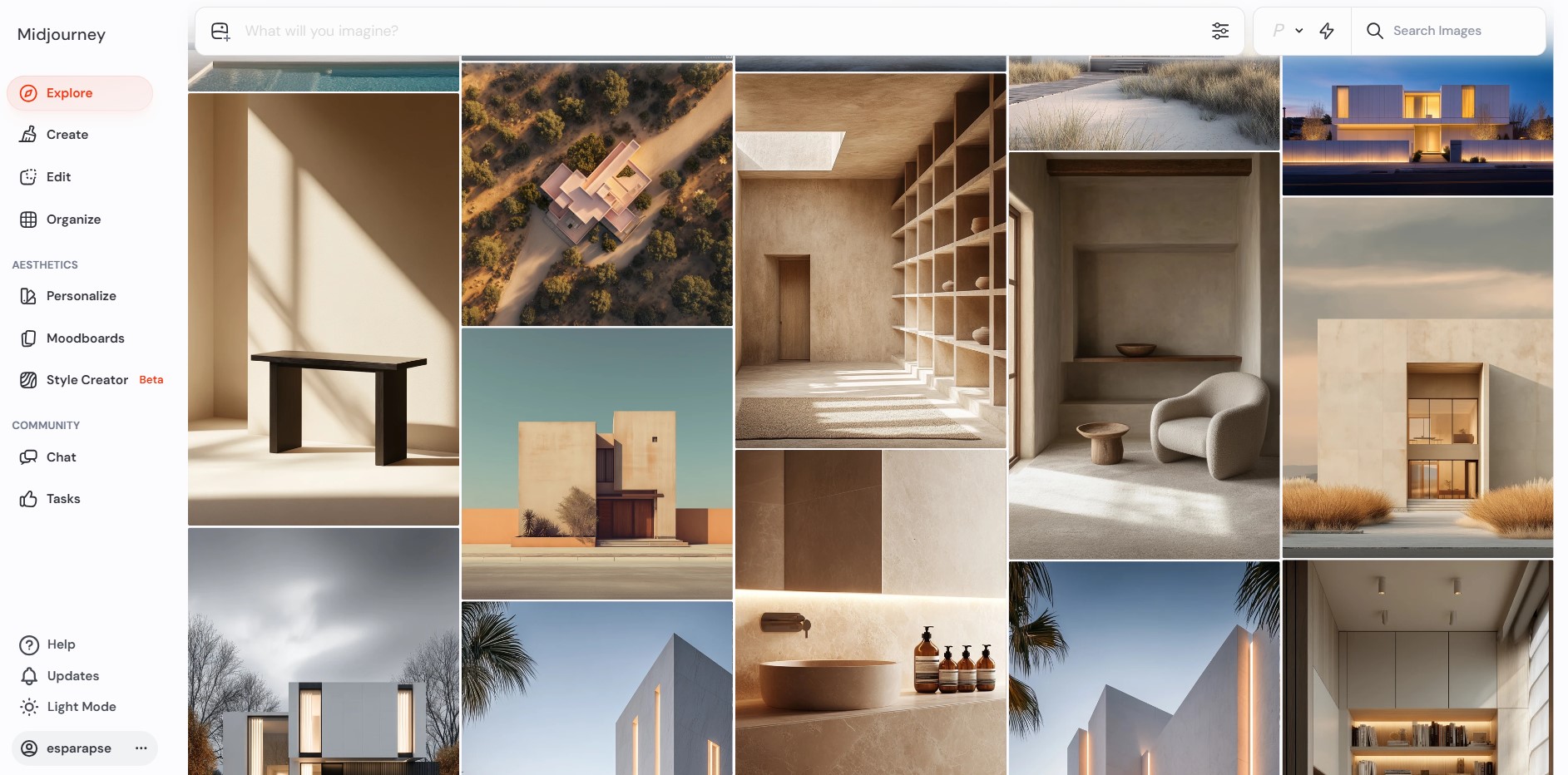

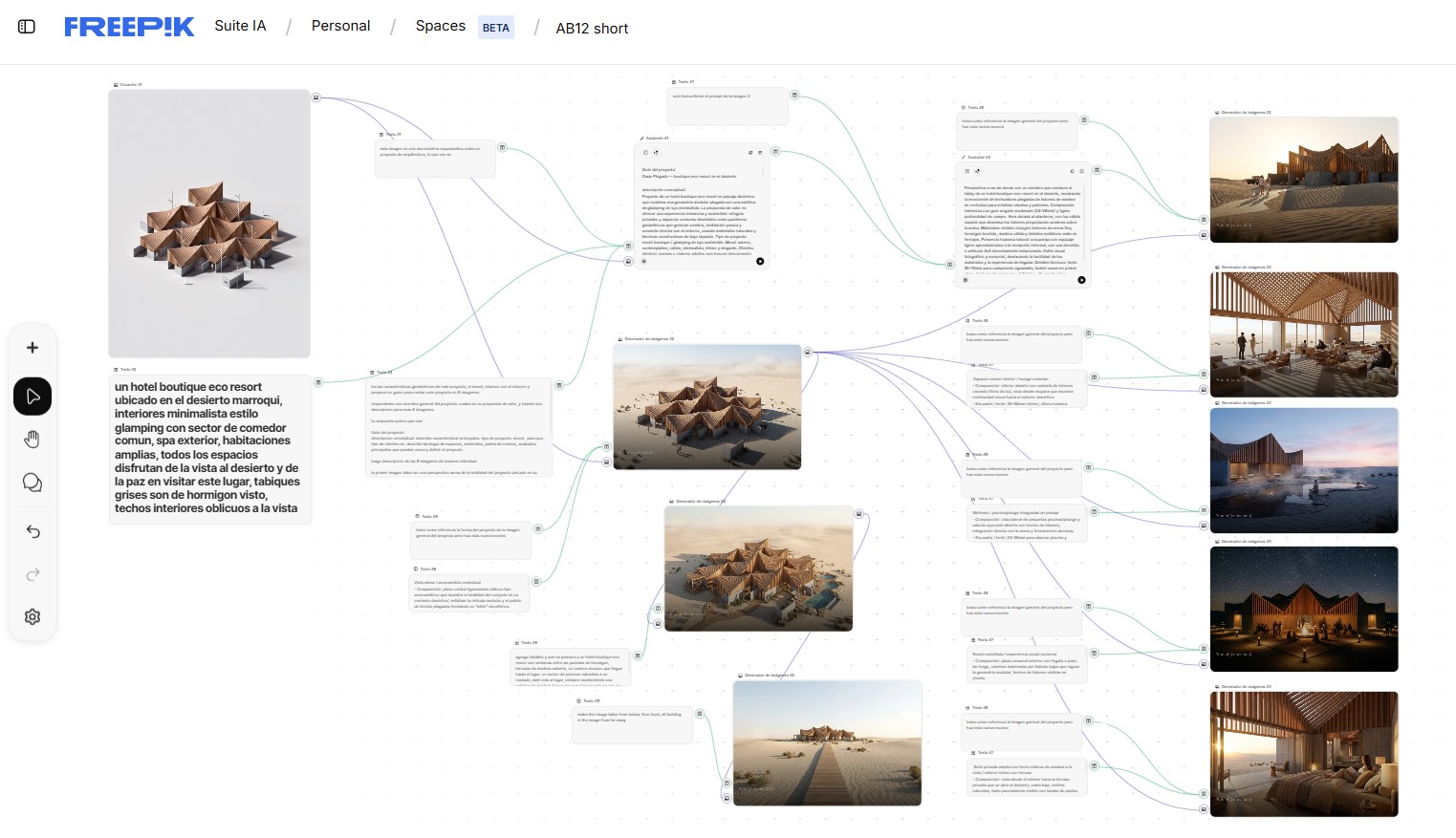

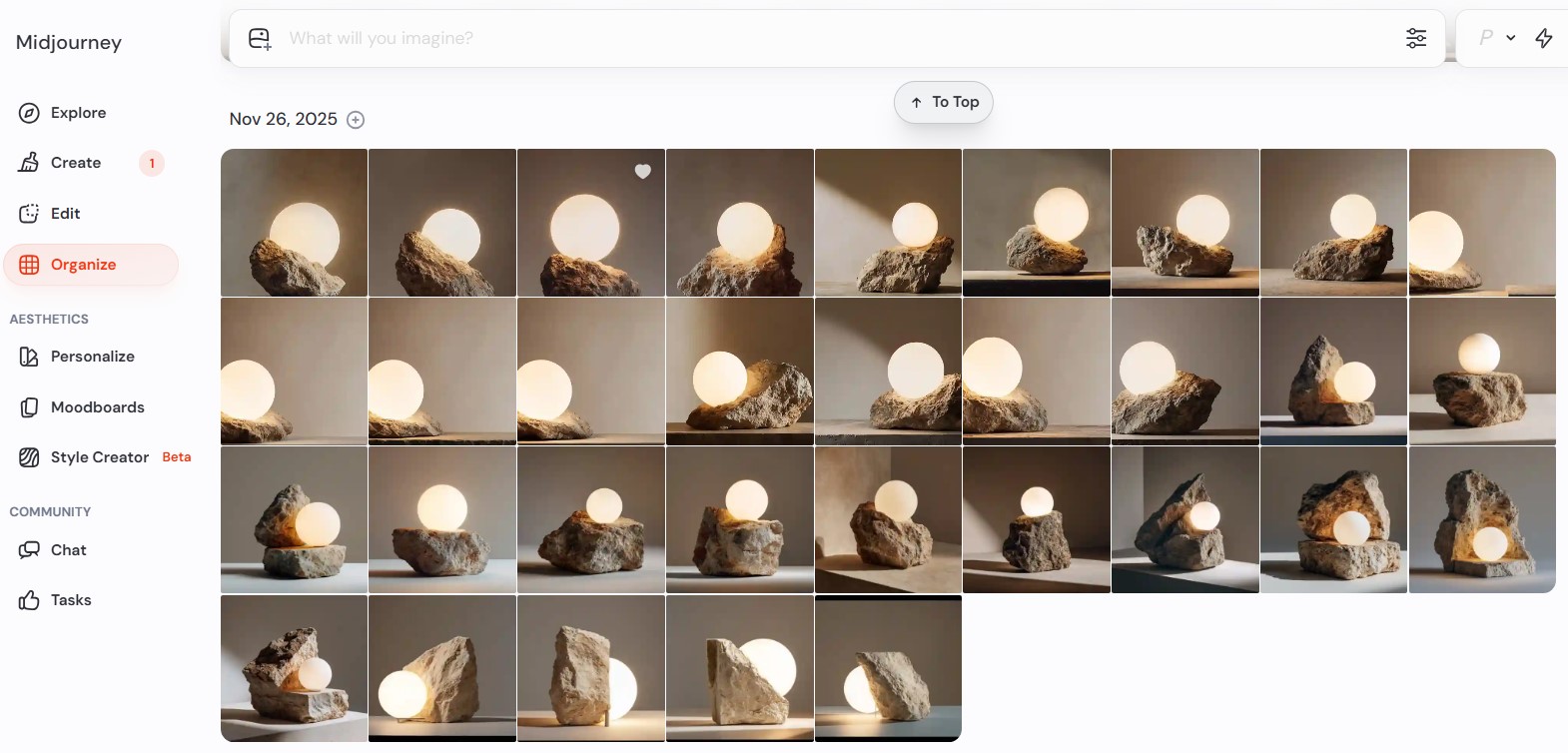

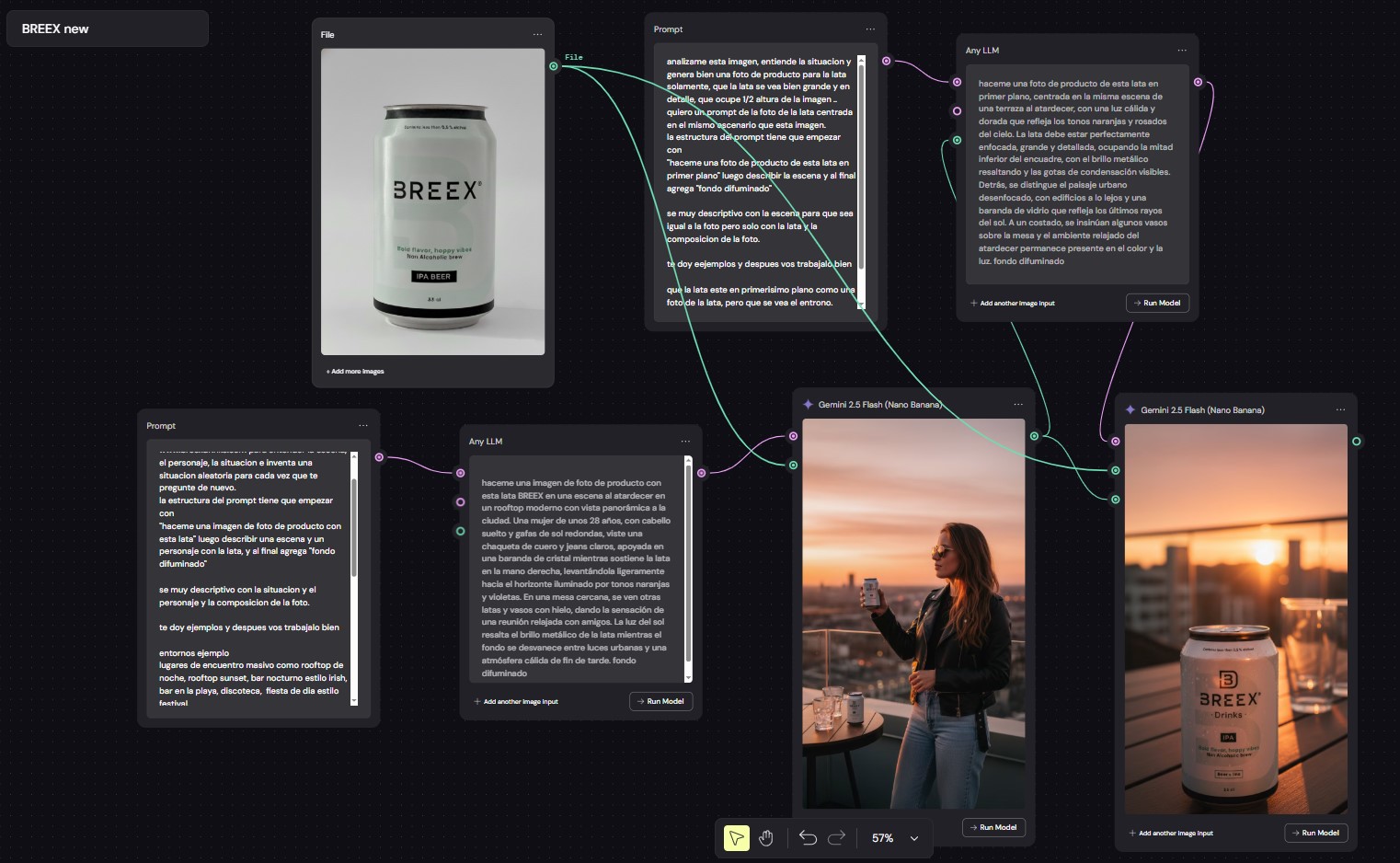

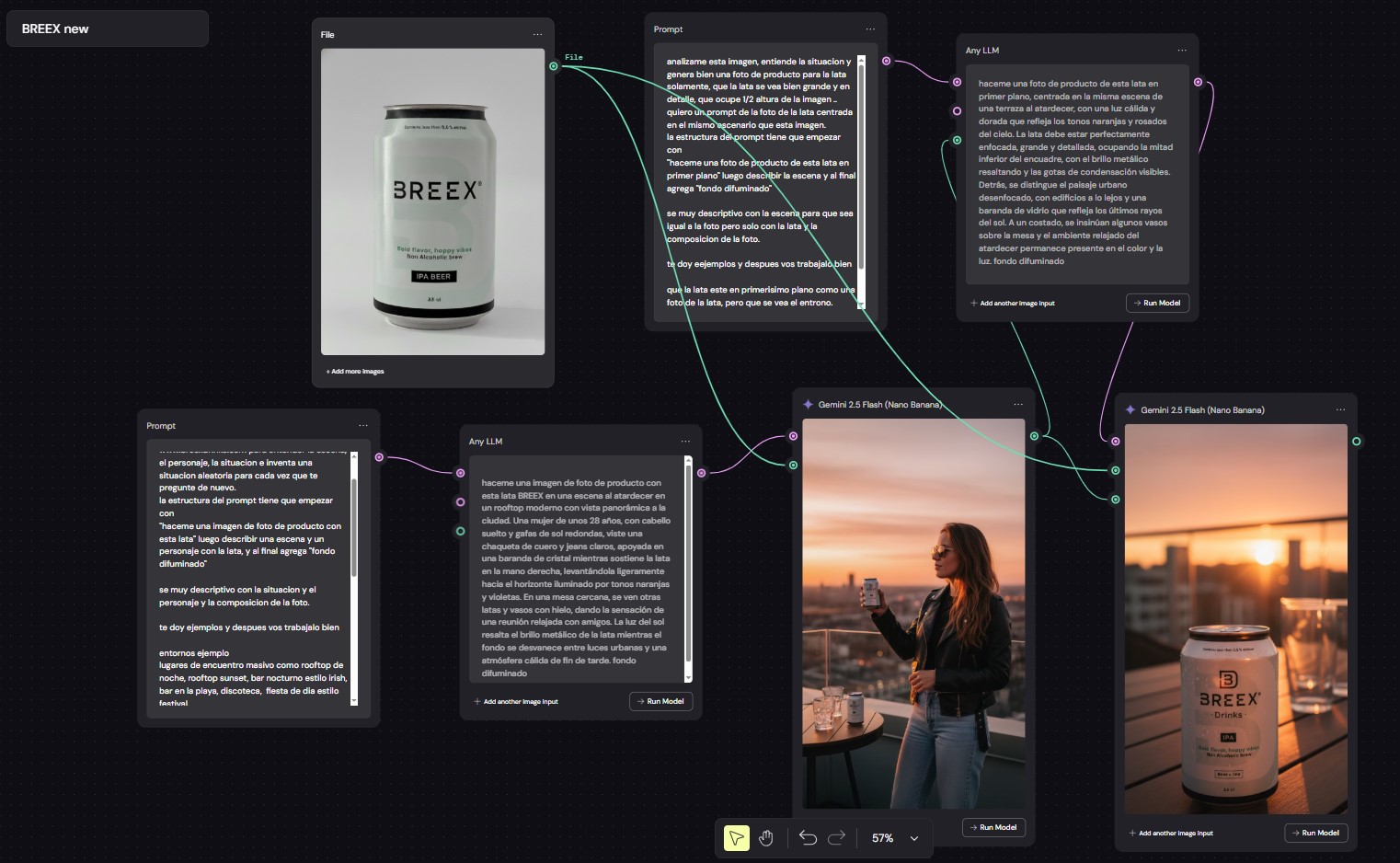

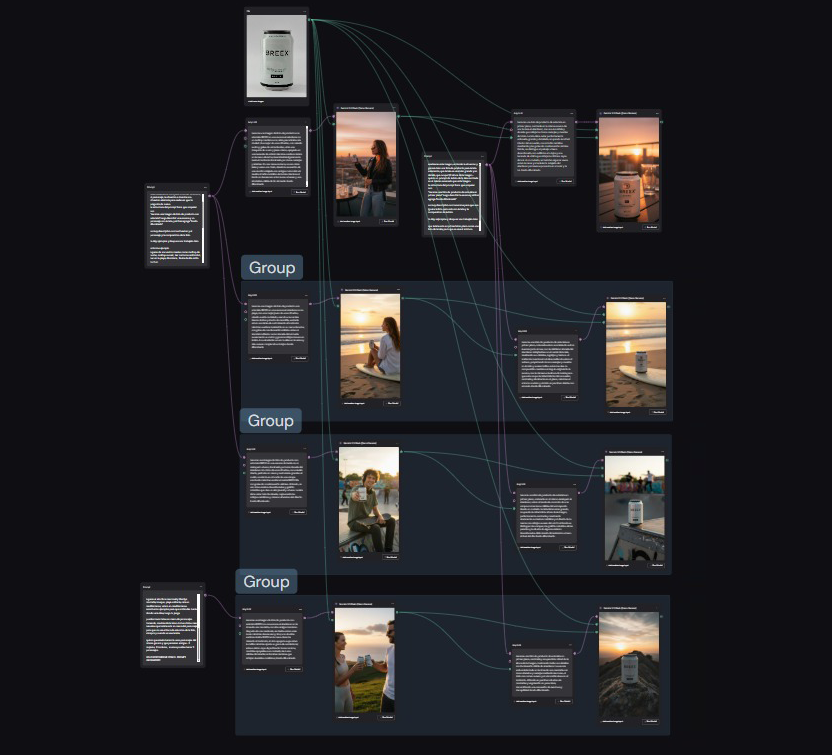

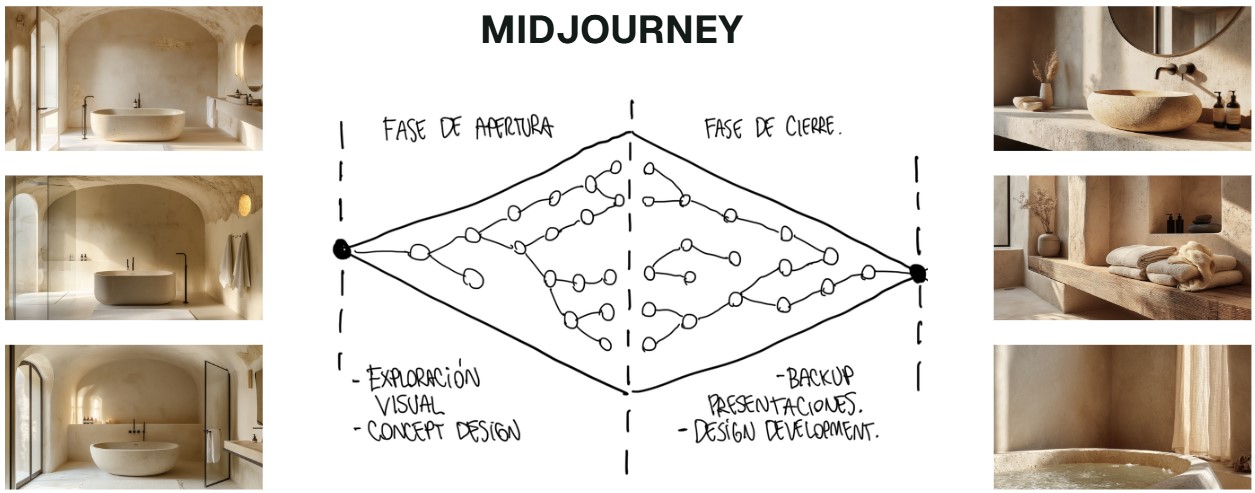

La clave, entonces, no está en dominar más herramientas ni en perseguir cada actualización, sino en entender los procesos reales de los estudios. Saber cuándo tiene sentido usar IA, en qué etapas del proyecto, con qué nivel de control y con qué intención. Por eso decidimos grabar un curso completo de Midjourney para Arquitectura e Interiorismo y subirlo a Youtube para promover el método AISEED.

Link al curso completo en Youtube

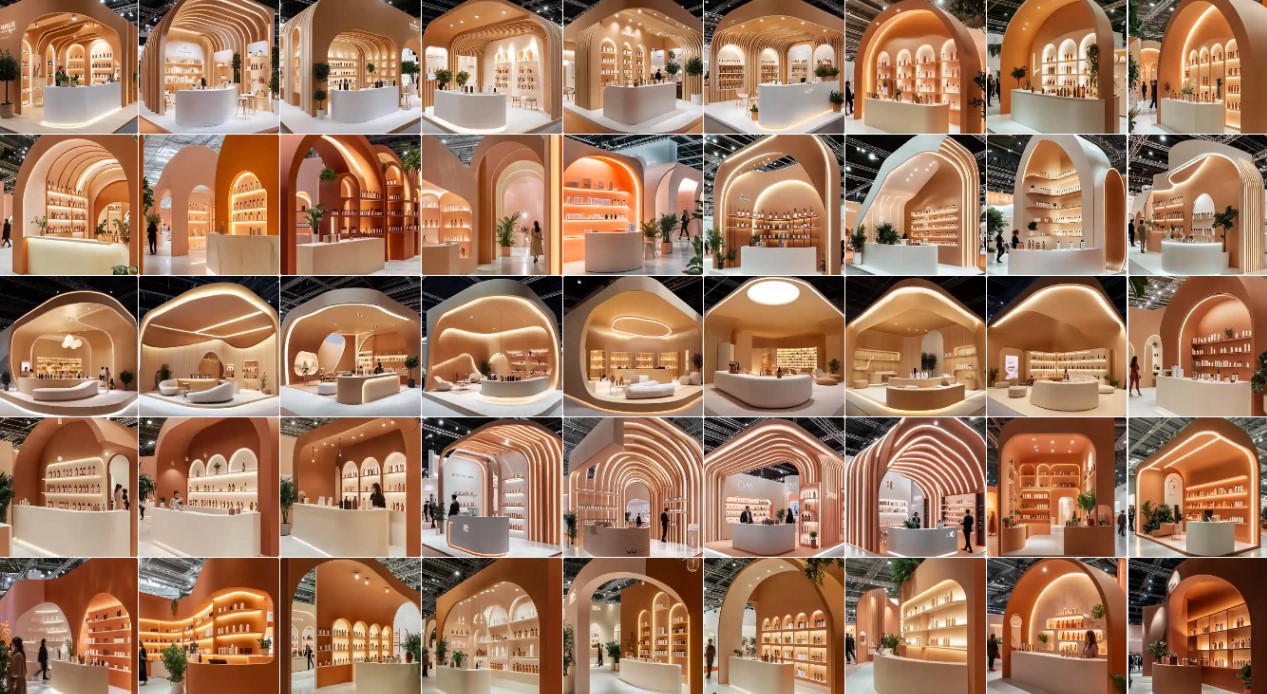

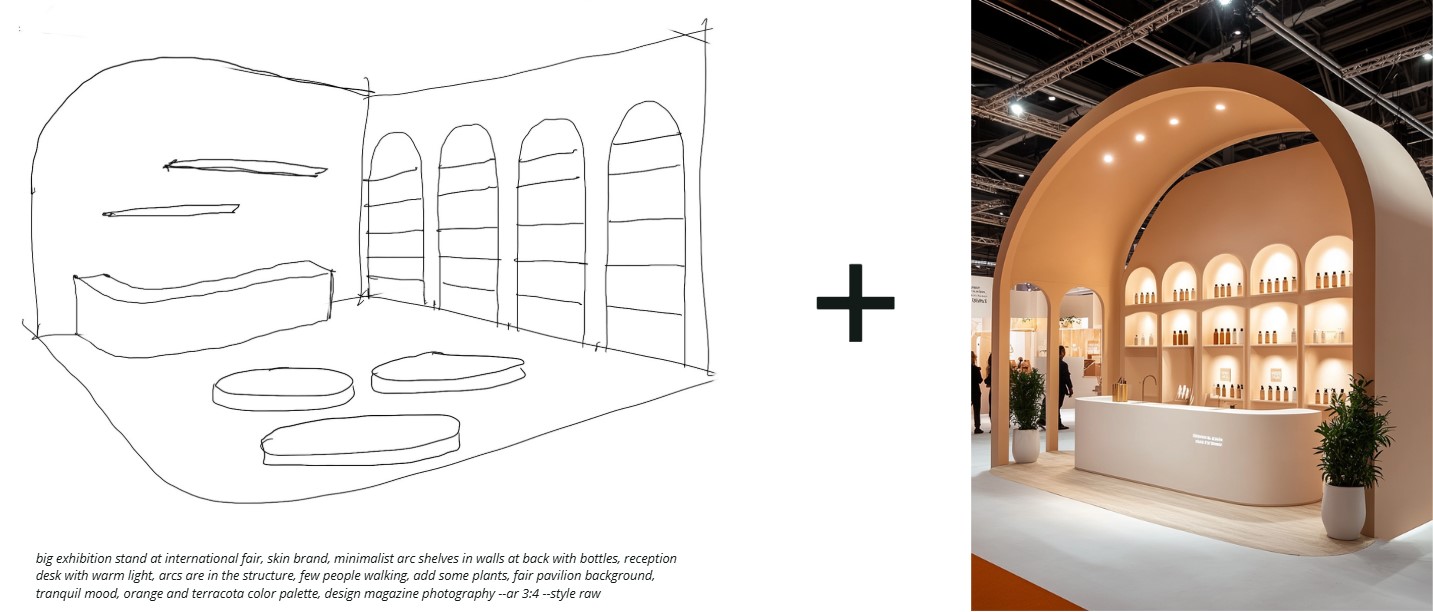

El video ordena conceptos básicos sobre qué es la IA y cómo impacta específicamente en la forma en que diseñamos. Recién a partir de esa base entramos en la generación de imágenes con Midjourney, cómo construir prompts con intención, cómo usar imágenes de referencia sin perder autoría y cómo combinar texto e imagen para explorar ideas.

El objetivo de publicar este bloque de forma abierta es para que la metodología AISEED esté al alcance de cualquiera que quiera entenderla, validarla, cuestionarla y opinar. Que el criterio no sea un contenido cerrado, sino una base común desde la cual empezar a pensar, debatir y mejorar cómo usamos IA en arquitectura e interiorismo.

Este curso funciona como una base conceptual sólida para profesionales independientes y equipos pequeños que quieren formarse con criterio y sin atajos. AISEED sigue siendo un training presencial para equipos, pero este bloque abierto es el punto de partida: ordena lenguaje, decisiones y mirada crítica. Si querés conocer el método AISEED y aprender a usar Midjourney con criterio, conciencia estética y sentido de autoría, el curso ya está disponible en YouTube.